구글이 검색 기능인 ‘서치 라이브(Search Live)’의 지원 범위를 전 세계로 확대했습니다. 3월 26일 공개된 내용에 따르면 이 기능은 AI 모드가 제공되는 모든 언어와 지역에서 사용할 수 있습니다. 이에 따라 200개가 넘는 국가와 지역에서 이용자들은 음성과 카메라를 활용해 검색과 대화를 이어갈 수 있게 됐습니다.

서치 라이브는 검색창에 텍스트를 입력하는 대신 말로 질문하고 답을 듣는 방식으로 작동합니다. 이용자는 안드로이드와 iOS용 구글 앱에서 검색창 아래의 라이브 아이콘을 눌러 기능을 실행할 수 있습니다. 질문을 음성으로 입력하면 오디오 형태의 답변을 받을 수 있고 이후 추가 질문도 이어서 할 수 있습니다. 관련 웹 링크도 함께 제공됩니다.

이번 확대에는 구글의 새 오디오·음성 모델인 제미나이 3.1 플래시 라이브가 적용됐습니다. 구글은 이 모델이 보다 자연스러운 대화를 지원하며 다국어 사용을 전제로 설계됐다고 설명했습니다. 이용자는 자신이 선호하는 언어로 검색과 대화를 진행할 수 있습니다.

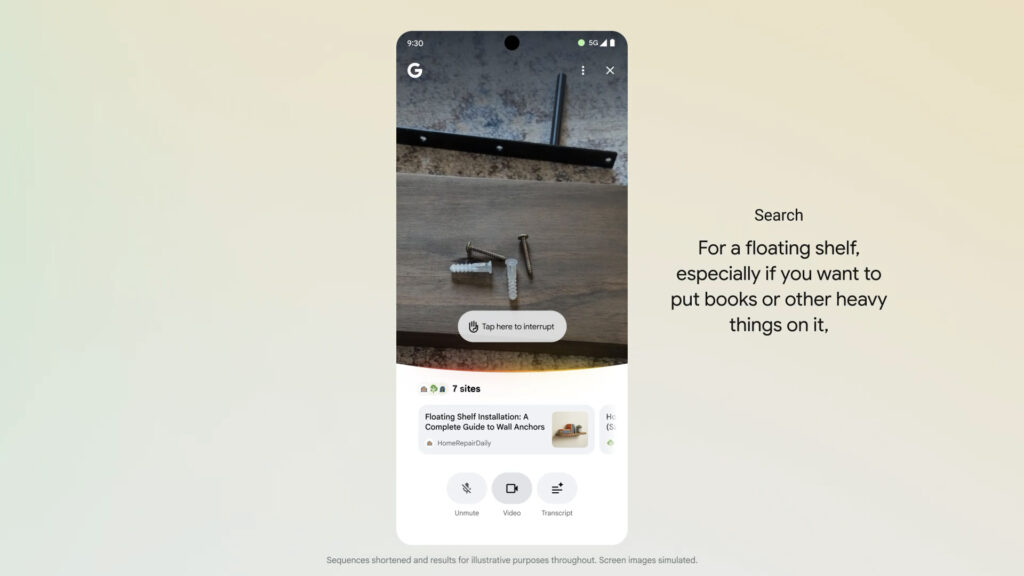

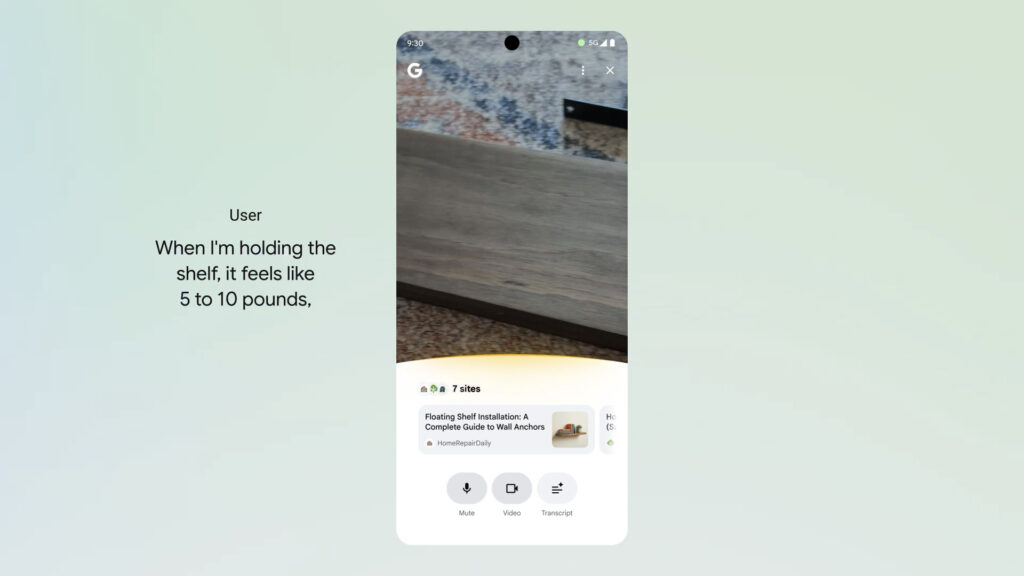

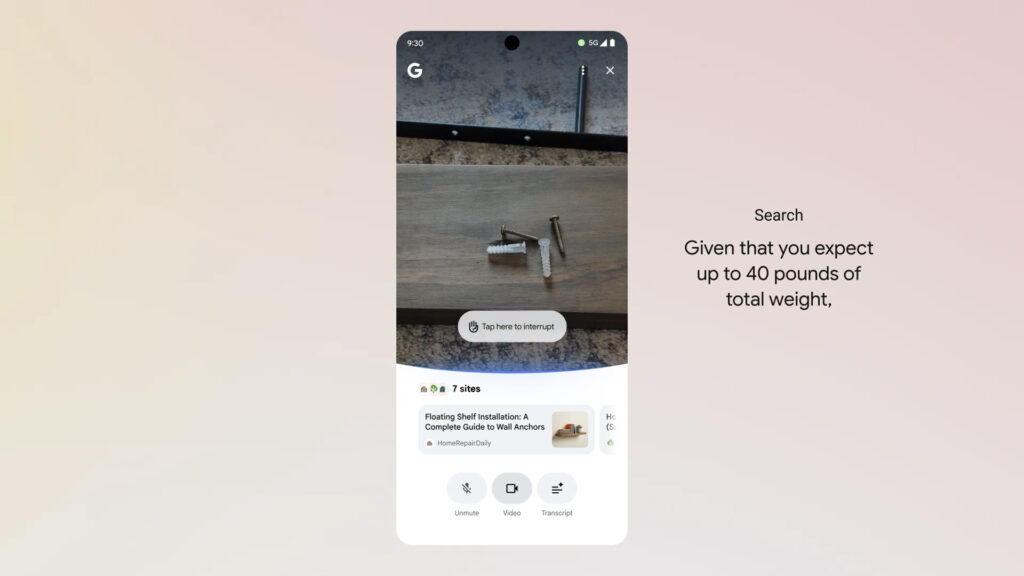

카메라를 함께 쓰는 방식도 포함됐습니다. 이용자가 눈앞의 사물을 보여주면 서치 라이브는 화면에 잡힌 장면을 바탕으로 답변을 제공합니다. 예를 들어 가구를 설치하는 상황에서 카메라로 부품과 설치 상태를 비추며 질문할 수 있습니다. 검색은 시각 정보를 함께 반영해 안내를 제공하고 추가로 확인할 수 있는 웹 정보도 연결합니다.

구글 렌즈와의 연동도 이뤄집니다. 이미 구글 렌즈로 대상을 비추고 있는 경우 화면 하단의 라이브 옵션을 눌러 바로 대화를 시작할 수 있습니다. 이는 사진 검색과 대화형 검색이 하나의 흐름으로 연결되는 방식입니다.

이번 조치는 구글 검색이 텍스트 입력 중심 구조에서 음성·영상 기반 상호작용으로 확장되고 있음을 보여줍니다. 이용자는 단어를 입력해 결과 목록을 확인하는 대신 현재 보고 있는 장면을 보여주고 바로 질문하는 방식으로 검색할 수 있게 됐습니다. 구글은 이를 통해 검색 기능을 실시간 상황 대응형 도구로 넓히고 있습니다.